درباره تکنولوژی که مصدق و میرزاخانی را زنده کرد

دیپفیک، نام تکنیک جدیدی برمبنای هوش مصنوعی است که بهواسطهی آن تصاویر و ویدئوهای دروغینِ واقعگرایانه درست میشود؛ موضوعی که اخیرا بسیاری را وحشتزده کرده است. انگار دیگر مرزی بین حقیقت و دروغ نیست.

برترینها: دیپ فیک، نام تکنیک جدیدی برمبنای هوش مصنوعی است که بهواسطهی آن تصاویر و ویدئوهای دروغینِ واقعگرایانه درست میشود؛ موضوعی که اخیرا بسیاری را وحشتزده کرده است. انگار دیگر مرزی بین حقیقت و دروغ نیست.

دیپ فیک یا جعل عمیق، ترکیبی از کلمههای یادگیری عمیق و جعلی، یک تکنیک برای ترکیب تصویر انسان مبتنی بر هوش مصنوعی است. جعل عمیق تصاویر و فیلمهای موجود را بر روی تصاویر یا فیلمهای منبع قرار میدهد و از یک تکنیک یادگیری ماشین به نام «شبکه مولد تخاصمی» (GAN) استفاده میکند. ویدیوی جعلی، ترکیب فیلمهای موجود و منبع است که فرد یا افرادی را درحال انجام یک کار در موقعیتی نشان میدهد که هرگز در واقعیت اتفاق نیفتاده است.

امروزه مرزهای تکنولوژی و فناوری خیلی فراتر از آنچه تصور میشود، گسترده شده است. اگر در گذشته تنها ممکن بود عکستان توسط نرم افزارهای مختلف گرافیکی دستکاری شده و چیزی خلاف واقعیت را به بیننده نشان دهد، امروز با فناوری خطرناک تری روبه رو هستیم که میتواند چهره و صدای شما را به طرز شگفت آوری تقلید کرده و در قالب ویدیوهای غیر واقعی منتشر کند.

امروزه ویدیوهای دیپ فیک بسیاری از هنرمندان و افراد مشهور ساخته میشود و بیننده بدون آنکه متوجه عدم صحت و واقعیت آنها شود، محتوای آنها را باور کرده و به انتشار آنها در فضای مجازی دست میزند. در نتیجه با توجه به پیشروی بدون محدودیت این فناوری، باید گفت که به زودی تشخیص بین مرز حقیقت و دروغ کاملا غیر ممکن میشود.

اگر علاقمند هستید درباره فناوری دیپ فیک بیشتر بدانید، پیشنهاد میشود با ادامه مقاله همراه باشید.

دیپ فیک یا فناوری «جعل عمیق» چیست؟

فناوری دیپ فیک یا «جعل عمیق» در سال ۲۰۱۴ برای اولین بار توسط یک دانشجوی مقطع دکترا به نام «ایان گودفلو» اختراع شد. گفتنی است گودفلو در حال حاضر در شرکت اپل مشغول به کار است.

دیپ فیک از ترکیب دو واژه دیپ (Deep) به معنای عمیق و فیک (Fake) به معنای جعلی و دروغین تشکیل شده است و براساس هوش مصنوعی قادر است تصاویر انسان را به صورت واقع گرایانه تولید و سنتز کند. در فناوری دیپ فیک یا همان جعل عمیق، از دسته خاصی از الگوریتم یادگیری ماشین با نام «شبکههای مولد تخاصمی» یا «Generative Adversarial Networks» استفاده میشود تا تصاویر یا ویدیوهای موجود روی مجموعهای از تصاویر و ویدیوهای منبع، ترکیب و برهم نهی شود.

دیپ فیک مبتنی بر روش یادگیری عمیق است و از شبکههای مولد تخاصمی که به اختصار به آنها شبکههای GAN گفته میشود، استفاده میکند. الگوریتمهای GAN از دو مدل هوش مصنوعی تشکیل میشوند. در این سیستم وظیفه یکی از مدلها تولید محتوا (تولید تصاویر افراد) و وظیفه مدل رقیب، تشخیص واقعی بودن و یا جعلی بودن عکس تولید شده است. گفتنی است در ابتدای کار مدل هوش مصنوعی رقیب قادر است به راحتی عکس جعلی را از عکس واقعی تشخیص دهد، اما با گذشت زمان دقت و عملکرد مدل هوش مصنوعی تولید کننده به قدری افزایش مییابد که تشخیص جعلی بودن محتوای تولید شده برای مدل رقیب بسیار سخت میشود.

چرا فناوری دیپ فیک خطرناک است؟

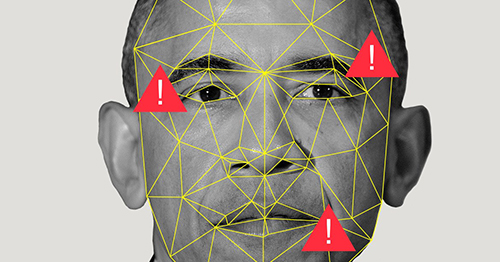

فناوری دیپ فیک یا همان جعل عمیق در طول ظهور و پیدایش خود، نه تنها جامعه بازیگران و سلبریتیها را هدف گرفته بلکه به حریم چهرههای بزرگ سیاستمدار نیز تجاوز کرده است. به عنوان مثال سال گذشته ویدئویی از باراک اوباما منتشر شد که در آن دونالد ترامپ را فردی حقیر و غیرمنطقی خطاب میکرد. اگرچه این ویدیو صحت نداشت و کاملا غیر واقعی بود، اما افراد زیادی در ابتدا آن را باورد کردند و دست به انتشار آن در فضای مجازی کردند. در همین راستا رئیس جمهور سابق آمریکا، باراک اوباما، در خصوص تکنولوژی دیپ فیک اظهار نظر کرده و ابراز کرده است در دنیایی که میتوانند به سادگی صحبتها و ویدیوهای غیرواقعی از من ساخته و منتشر کنند، به مرحلهای خواهیم رسید که تشخیص مرز بین واقعیت و دروغ بسیار مشکل خواهد شد و این مطمئنا بر پایههای دموکراسی ما که بر مبنای حقیقت است، تاثیر خواهد گذاشت.

در حقیقت از آنجا که این فناوری بر مبنای هوش مصنوعی است و نیازی به دخالت مستقیم انسان ندارد، هر فردی میتواند از طریق دیپ فیک، ویدیوی جعلی و در عین حال واقعگرایانه تولید کند. در نتیجه متاسفانه افراد با اهداف خصمانه میتوانند فیلمهای غیراخلاقی از چهرههای مشهور تهیه و تولید کنند و زندگی شخصی آنها را به راحتی به خطر بیندازند. گفتنی است این فناوری سبب کسب درآمد نیز شده است و افراد بسیاری در انجمنهای اینترنتی مختلفی وجود دارند که حاضرند برای ساخت یک ویدیوی دیپ فیک و غیراخلاقی از فرد موردنظرشان پول زیادی پرداخت کنند.

علاوه بر ایجاد محتوای غیراخلاقی از افراد مختلف، دیپ فیک میتواند واقعیات جامعه را تحریف کرده و اطلاعات نادرست و غیرواقعی به افراد جامعه ارائه کند. در نتیجه حریم خصوصی افراد به راحتی مورد هدف قرار گرفته و دموکراسی و امنیت ملی یک کشور نیز به خطر میافتد.

سرنوشت نرم افزار دیپ فیک Zao که ویدیوی جعلی میساخت

اپلیکیشن چینی Zao که چندی پیش به عنوان یکی از پرسروصداترین اپها شناخته میشد، قادر است در کسری از ثانیه با دریافت چند عکس از کاربر، چهره او را به سلبریتی موردعلاقهاش تبدیل کند. اما پس از چندی کاربران بسیاری به سرعت موجی از نارضایتی خود را در خصوص نقض حریم خصوصی خود اعلام کردند و حال این نرم افزار، سیاستهای خود را بعد از واکنش جدی و بازخوردهایی که از سوی کاربران دریافت کرده، تغییر داده است.

این اپلیکیشن قادر است با استفاده از هوش مصنوعی، تصویر چهره کاربر را روی چهره یک شخص دیگر گذاشته و در قالب یک فایل گیف (GIF) و یا حتی ویدیو آن را به نمایش درآورد. نرم افزار دیپ فیک Zao یک اپلیکیشن رایگان است و به عنوان یکی از پرطرفدارترین برنامههای موجود در اپ استور شناخته میشود. نحوه نصب و استفاده از این برنامه بسیار ساده و آسان است. کافی است پس از نصب، شماره موبایل خود را وارد کرده و سپس تعدادی از عکسهای موجود در گوشی خود را روی برنامه بارگذاری کنید. حال میتوانید ویدیوهای سلبریتیهای مختلف از دی کاپریو گرفته تا مارلین مونرو، یکی را انتخاب کنید تا اپلیکیشن چهره شما را روی تصویر سلبریتی مورد علاقه تان بر هم گذاری کند.

اما منبع خبری رویترز گزارش میکند که کاربران بسیاری پس از اینکه متوجه شدند با بارگذاری تصویر خود در Zao، این اجازه را به اپلیکیشن میدهند که از تصاویر آنها برای اهداف بازاریابی و تجارت خود استفاده کند، بسیار شاکی شدند و آن را نقض حریم خصوصی خود میدانند. درواقع اپلیکیشن Zao با استفاده از فناوری دیپ فیک قادر است در عرض چند ثانیه به طرز ماهرانهای چهره کاربران را با تصاویر دیگر بازیگران جابهجا کند، این در حالی است که در نسخه قبلی این برنامه، عکسهای کاربران برای همیشه در مالکیت توسعه دهندگان این برنامه قرار میگرفت و سازنده اپ میتوانست بدون هیچ محدودیتی آنها را در اختیار شرکتهای دیگر قرار دهد. اما پس از اعلام نارضایتی کاربران و حاشیهای که پیرامون این نرم افزار پیش آمد، توسعهدهندگان این اپلیکیشن مجبور شدند که تمام عکسهای قبلی کاربران را از سرورهای خود حذف کنند. سازندگان این نرم افزار طی بیانیهای اعلام کردند که یکسری نگرانی در خصوص نقض حریم شخصی کاربران ایجاد شده بود که در همین راستا بند استفاده آزادانه از عکسهای کاربران را از Zao حذف کردیم.

در حال حاضر برنامههای متنوعی نظیر Zao موجود هستند که با تکنیک هوش مصنوعی و دیپ فیک، چهره کاربر را تغییر میدهند و بیشتر جنبه فان و سرگرمی دارند، اما با توجه به گزارشات متعدد در مورد نقض حریم شخصی کاربران، توصیه میشود قبل از استفاده از این نوع اپلیکیشنها، قوانین هر کدام را با دقت مطالعه کنید. آخرین نمونه آن اپلیکیشن گرادینت است که در حال حاضر همه گیر شده و به شدت امنیت و حفظ حریم خصوصی استفاده کنندگان از آن زیر سوال است.

همانطور که مشاهده کردید در آیندهای نه چندان دور و با گسترش فناوری دیپ فیک، عملا تشخیص بین مرز حقیقت و دروغ غیرممکن خواهد شد. علاوه براین تولید و فراگیر شدن نرمافزارهای تغییر چهره مبتنی بر دیپ فیک نیز هشداری جدی بر نقض حریم خصوصی کاربران هستند. باید منتظر ماند و دید که پیشرفت بی مهابای فناوری تا کجا بر زندگی افراد تاثیر خواهد گذاشت.

در این قسمت نمونهای از استفاده از فناوری دیپ فیک برای تولید ویدئوی غیرواقعی از افراد معروف ارائه شده است:

دیپ فیک آهنگ «ایران من» همایون شجریان با چهرههای ملی نظیر مریم میرزاخانی، مصدق، تختی و پروین اعتصامی و... ر ا ببینید.

منبع: دویچه وله، پلازا و ویرگول

نظر کاربران

این نماهنگو دیدم خوشم اومد

ولی خب واقعا ابزار خطرناکی بنظر میاد

شنیده بودیم در آخرالزمان تشخیص حق و باطل خیلی خیلی سخت میشه

پاسخ ها

شما هم که هر چیزی رو به آخر زمان ربط میدین

به نظر من یه جورایی هتک حرمت بزرگان هست و از نظر اخلاقی درست نیست .

اینجوری باشه دو روز دیگه ساسی مانکن هم آهنگش رو میکس میکنه رو امیرکبیر .

عالی بود!!!

افراد بزرگ همیشه زنده هستند

اینم مثل فوتوشاپ اگه کمی دقت کنید قابل تشخیصه

پاسخ ها

کمی دقت؟ بسیااااااااااااار تابلو هست که مصنوعیه و فقط تکرار حرکات یکسان بصورت کاملا غیر طبیعی

کسانی که علاقه دارن این ویدئو یک دقیقه بیشتره

چرا از برنامه خارجی استفاده میکنی برای ساختن یه کلیپ تماما ایرانی

از برنامه خارجی کپی نکنی بیشترم شگفت زده میشیم

مریم میرزاخانی هیچ عرقی به ایران نداشت حتی با مرد ایرانی هم ازدواج نکرد چرا انقدر میچسبونیدش به ایران

پاسخ ها

همین که تو به ایران عرق داری واسه همه کافیه

تو چرا گیر دادی که مریم میرزاخانی چرا با مرد ایرانی ازدواج کرد عزیز من

چندبارم گفتی ول کن دیگه

بعدشم با مرد ایرانی ازدواج میکرد چی میشد به حرف خواهر و مادرشوهر چهار بچه به دنیا بیاره که سه تاشم باید پسر باشه

بقیه با مرد ایرانی ازدواج کردند چی شدند؟

اشتباه نکن عزیزم کسی مریم میرزاخانی رو به ایران نمیچسبونه. این ایرانه که به مریم میرزاخانی چسبونده میشه. به هرکس هم که بر میخوره بخوره حقیقت تلخه.

ویدئوی اخری خیلی مزخرف بود

چقد ویدیوی اخری قشنگ بود

چه شخصیت هایی رو نشون داد. اشک تو چشام جمع شد