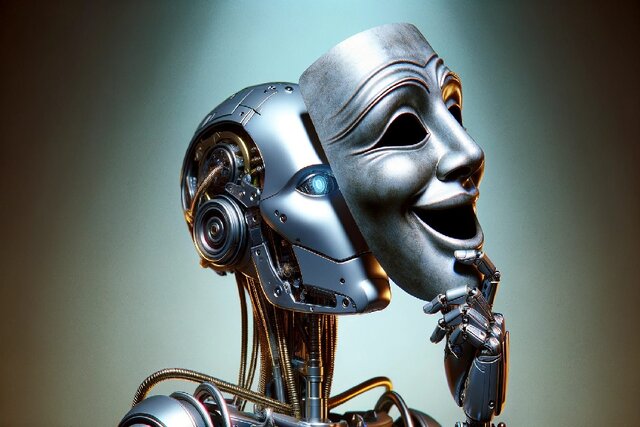

هوش مصنوعی، شخصیت ۱۰۰۰ نفر را کپی کرد!

گروهی از پژوهشگران «دانشگاه استنفورد» و «گوگل دیپمایند» با کمک هوش مصنوعی، کپیهایی را از شخصیت ۱۰۰۰ شرکتکننده ساختند و تقلید آنها را از همتایان انسانی خود بررسی کردند.

ایسنا: تصور کنید که با یک مدل هوش مصنوعی برای یک مصاحبه به مدت دو ساعت گفتوگو میکنید. یک صدای دوستانه به واسطه این گفتوگو که اطلاعاتی را از دوران کودکی، خاطرات و کار تا افکار شما درباره سیاست مهاجرت شامل میشود، شما را راهنمایی میکند. مدتی بعد، یک کپی مجازی از شما میتواند ارزشها و ترجیحات شما را با دقت خیرهکنندهای به تصویر بکشد.

به نقل از امآیتی تکنولوژی ریویو، پژوهش جدید گروهی از پژوهشگران «دانشگاه استنفورد»(stanford university) و «گوگل دیپمایند»(Google DeepMind) نشان میدهد که این ایده اکنون امکانپذیر است.

این گروه پژوهشی به سرپرستی «جون سونگ پارک»(Joon Sung Park) دانشجوی مقطع دکتری علوم رایانه دانشگاه استنفورد، ۱۰۰۰ نفر را برای این پژوهش استخدام کردند که براساس سن، جنسیت، نژاد، محل سکونت، تحصیلات و ایدئولوژی سیاسی با یکدیگر تفاوت داشتند. هر کدام از این افراد برای مشارکت در این پژوهش تا ۱۰۰ دلار دستمزد دریافت کردند. پژوهشگران از طریق مصاحبه با شرکتکنندگان، نمونههایی را از کپی آن افراد ایجاد کردند. شرکتکنندگان طی آزمونی که نشان میدهد عوامل هوش مصنوعی چگونه از همتایان انسانی خود تقلید میکنند، مجموعهای را از آزمایشهای شخصیتی، نظرسنجیهای اجتماعی و بازیهای منطقی به فاصله دو هفته انجام دادند. سپس، عوامل هوش مصنوعی همان آزمایشها را تکمیل کردند و نتایج ۸۵ درصد مشابه بود.

پارک گفت: من معتقدم اگر بتوانید یک گروه را از نمونههای کوچک خود داشته باشید و تصمیماتی را بگیرید که قبلا میگرفتید، در نهایت آینده را شکل خواهید داد.

کپیهای هوش مصنوعی در این پژوهش، «عوامل شبیهسازی» نامیده میشوند و انگیزه ایجاد آنها این است که انجام شدن پژوهشها را برای محققان حوزه علوم اجتماعی و سایر زمینهها آسانتر کند. اگر بتوانید مدلهای هوش مصنوعی بسازید که مانند افراد واقعی رفتار کنند، میتوانید از آنها برای آزمایش هر چیزی استفاده کنید؛ از مبارزه با اطلاعات نادرست در رسانههای اجتماعی گرفته تا شناسایی رفتارهایی که به ترافیک منجر میشوند.

عوامل شبیهسازی کمی متفاوت از عواملی هستند که امروزه بر کار شرکتهای پیشرو در حوزه هوش مصنوعی تسلط دارند. عوامل دوم موسوم به «عوامل مبتنی بر دستگاه»، مدلهایی هستند که به منظور انجام دادن کارها برای شما ساخته شدهاند، نه این که با شما صحبت کنند. برای مثال، آنها ممکن است کارهایی را مانند وارد کردن دادهها، بازیابی اطلاعات ذخیرهشده یا رزرو سفر و برنامهریزی قرار ملاقاتها انجام دهند. به گفته بلومبرگ، «سیلزفورس»(Salesforce) در ماه سپتامبر عوامل مبتنی بر دستگاه خود را معرفی کرد. سپس، «آنتروپیک»(Anthropic) در ماه اکتبر عوامل خود را عرضه کرد و «اوپنایآی»(OpenAI) نیز قصد دارد برخی از آنها را در ژانویه عرضه کند.

این دو نوع عامل، متفاوت هستند اما نقاط مشترکی دارند. «جان هورتون»(John Horton) دانشیار فناوری اطلاعات دانشگاه «امآیتی»(MIT) که یک شرکت را برای انجام دادن تحقیقات با استفاده از هوش مصنوعی تأسیس کرده است، گفت: پژوهشهای مبتنی بر عوامل شبیهسازی مانند مواردی که در این پژوهش ارائه شدهاند، احتمالا به طور کلی به ایجاد عوامل هوش مصنوعی قویتر ختم خواهد شد.

وی افزود: این پژوهش نشان میدهد چگونه میتوان از انسانهای واقعی برای تولید شخصیتهایی استفاده کرد که به صورت برنامهنویسی/شبیهسازی در روشهای غیر قابل انجام دادن با انسانهای واقعی استفاده شوند.

نظر کاربران

در حال کپی برداری از شخصیت های انسانی هستند به بهانه تست و آزمایش های علمی برای تولید انسانهای مصنوعی در ماتریکس که چین سالها است در حال انجام آن است

بزودی شاهد نمونه های واقعی انسانی از اشخاص مهم سیاسی و ثروتمند خواهیم بود که دیگر نیازی به بدل نداشته باشند

خطرناک شده هر لحظه بروزتر میشه

عجب